El lado oscuro de la IA es, probablemente, su uso por los ciberdelincuentes en el deepfake, ransomware y otras amenazas.

Desde Unit 42, los especialistas de Palo Alto Network advierten de una nueva modalidad.

Son muchas las ventajas que la Inteligencia Artificial está incorporando en nuestras vidas. Pero también ha generado más trabajo para quienes laboran en ciberseguridad.

La creatividad de los hackers maliciosos ha sabido innovar sua trampas. El deepfake es la perfecta muestra de lo que la Inteligencia Artificial (IA) puede hacer a favor de múltiples formas de fraude.

El departamento de investigación de amenazas de Palo Alto Network (PAN) ha descubierto docenas de campañss con una nueva modalidad de fraude.

Según el más reciente informe de Unit 42, grupos criminales especializados en ataques en la web están desarrollando campañas de estafas a través de la manipulación de videos “deepfake”.

¿La diferencia de otros ataques? Pues los ciberdelincuentes están usando la imagen de figuras públicas, incluidos:

- Directores ejecutivos

- Presentadores de noticias

- Y altos funcionarios gubernamentales

Estas operaciones han sido desarrolladas en distintos idiomas y difunden esquemas de inversión falsos, así como obsequios fraudulentos a nombre de gobiernos.

Algunas de estas çampañas se encuentran dirigidas a engañar a posibles víctimas en distintos países, incluidos Canadá, México, Francia, Italia, Turquía, República Checa, Singapur, Kazajistán y Uzbekistán.

Tome nota, por si acaso

Como ejemplo de la amenaza que podría causarle problemas esta Capitalflow-skillful.shop, un sitio web fraudulento que utiliza un video manipulado por Inteligencia Artificial (IA) de Andrés Manuel López Obrador, el presidente de México.

Esta elaborada trampa tiene el objetivo de promover un falso “Proyecto de Sociedad Mexicana de Inversiones”.

Como ya señalamos, el informe de Unit 42 ha encontrado celadas como esta en los nueve países ya mencionados. No obstante, las similitudes tácticas y de infraestructura, permiten suponer que muchas de estas campañas surjen de un solo grupo de cibercriminales.

Esto habla de una organización bien articulada. El informe destaca que, en junio de 2024, se descubrieron cientos de dominios que se utilizaban para promocionar estas estafas de deepfake.

En la misma documentó que se accedió a cada dominio un promedio de 114.000 veces en todo el mundo desde que se pusieron en marcha. Asi lo muestra la telemetría de DNS pasivo (pDNS) de Unit 42.

Otro caso es el de Griffinware-tm.cloud, un sitio web que utiliza un video deepfake de Lee Hsien Loong, ex primer ministro de Singapur. Este sitio promueve la estafa de Quantum IA.

Numerosas campañas generaron una importante cantidad de videos que se compartían, ampliamente, a través de sitios web alojados en dominios recién registrados.

No obstante, tras una investigación profunda, los expertos de Palo Alto Network identificaron que los videos estaban alojados, principalmente, en un solo dominio: Belmar-marketing.online.

Cuestión de confianza

Posteriormente, el estafador le indica a la víctima que descargue una aplicación para que pueda “invertir” más de sus fondos.

Una vez dentro de la aplicación, aparece un panel que muestra pequeñas ganancias. A partir de ahí, los criminales continúan persuadiendo a los afectados para que depositen más dinero e, incluso, pueden permitirle retirar una pequeña cantidad como una forma de ganarse su confianza.

Finalmente, cuando la víctima intenta retirar sus fondos, les exigen comisiones por retiro o interponen alguna otra razón por la que no pueden recuperar el dinero.

Es, entonces, cuando proceden a bloquear la cuenta y quedarse con lo restante, lo que hace que la víctima pierda la mayor parte que puso en la “plataforma”.

Aunque, a dimple vista, es muy elaborado, esta estafa de deepfake sólo es la evolución del phishing: con esteroides y con mucha elaboración.

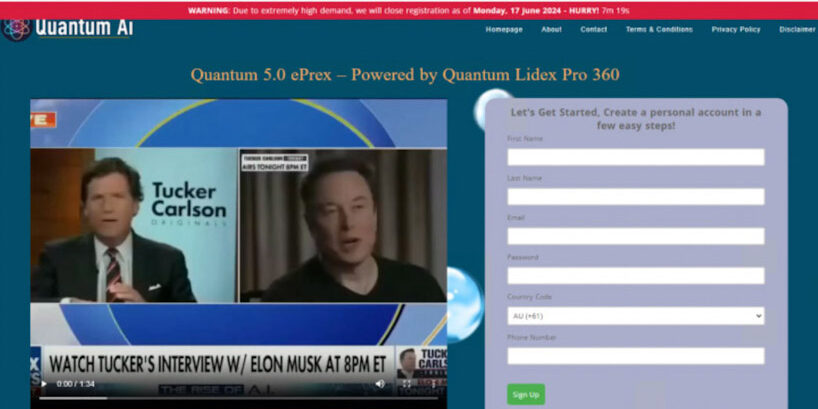

Bitquantumai[.]com, un sitio web que utiliza un video deepfake de Elon Musk y Tucker Carlson para promover la estafa de inteligencia artificial cuántica.

A pesar del uso de inteligencia artificial generativa (GenAI) en estas campañas, las técnicas de investigación tradicionales siguen siendo útiles para identificar la infraestructura de alojamiento que utilizan los creadores de amenazas.