NVIDIA redefine el ROI tecnológico mediante la arquitectura Vera Rubin y la transición del modelo Software-as-a-Service al Agentic-as-a-Service.

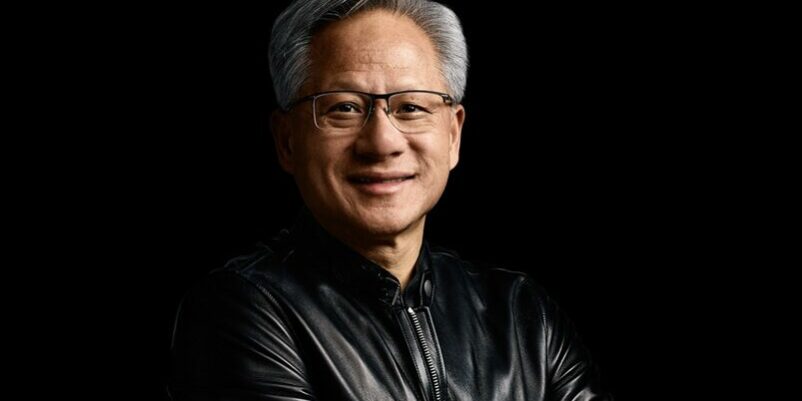

El Keynote del NVIDIA GTC 2026, a cargo de su CEO Jensen Huang, marcó el fin de la percepción de la compañía como un simple proveedor de componentes para consolidarse como el arquitecto de las fábricas de inteligencia.

La metamorfosis es profunda: el centro de datos ya no se diseña para procesar archivos, sino para generar tokens, el nuevo activo económico de la era digital. Esta transición responde a una demanda de mercado proyectada en $1 trillón de dólares para 2027, impulsada por la necesidad de convertir la computación acelerada en conocimiento operativo.

Huang sostiene que la industria ha pasado de los centros de datos tradicionales, que almacenaban archivos, a las “Fábricas de IA”, una nueva plataforma diseñada para convertir datos en conocimiento mediante la generación masiva de tokens,,. En esta nueva era, los tokens son la nueva mercancía básica (commodity) y el “output” principal de la infraestructura moderna.

“Así es como se fabrica la inteligencia: un nuevo tipo de fábrica generadora de tokens, los bloques de construcción de la IA”, destacó Huang.

Para el C-Suite de empresas e instituciones públicas, la prioridad se desplaza del rendimiento bruto a la eficiencia en la producción masiva de tokens. Los anuncios de este año establecieron las coordenadas de una infraestructura diseñada para la acción autónoma, fundamentada en cinco pilares estratégicos.

Plataforma Vera Rubin: Eficiencia energética en escala industrial

La arquitectura Vera Rubin representa una respuesta técnica a la restricción física más crítica de los centros de datos: la energía. Con un rendimiento por vatio 35 veces superior a las generaciones previas, la plataforma busca maximizar la producción de un rack de 1.0 gigavatio, cuya construcción base ya demanda inversiones de $40 mil millones.

El CEO de NVIDIA explicó que la computación de propósito general (CPUs) ya no puede ofrecer los saltos de rendimiento necesarios para la IA, ya que duplicar el rendimiento cada pocos años ya no es suficiente. Para superar este límite, NVIDIA se posiciona como una “compañía de algoritmos” que utiliza el cómputo acelerado y bibliotecas específicas de dominio (como CUDA X) para reducir costos y aumentar la escala de manera continua.

“La Ley de Moore se ha quedado sin vapor; necesitamos un nuevo enfoque. El cómputo acelerado nos permite dar estos pasos gigantescos hacia adelante”.

Un punto de inflexión para el CIO es la consolidación de la Vera CPU como un negocio independiente de miles de millones de dólares. Al ser la única CPU de centro de datos que integra memoria LPDDR5, ofrece un rendimiento single-thread y una eficiencia por vatio sin paralelos, optimizada específicamente para que los agentes utilicen herramientas digitales. Según la presentación de la integración vertical de NVLink 72 y el enfriamiento líquido directo permiten que la infraestructura tenga una vida útil prolongada, reduciendo drásticamente el costo total de propiedad (TCO).

Sinergia Vera Rubin + Grock: Inferencia desagregada y la comoditización del token

NVIDIA ha resuelto el cuello de botella de la inferencia mediante la integración de la tecnología de Grock (LPU), logrando un aumento de 350 veces en el throughput. La clave reside en el software Dynamo, que permite una “inferencia desagregada”: mientras la arquitectura Vera Rubin gestiona la fase de prefill (procesamiento de grandes contextos), las unidades de Grock aceleran el decode (generación de tokens con baja latencia).

Esta capacidad permite a las empresas segmentar su oferta en niveles de servicio con una lógica de precios clara:

- Tier Gratuito/Básico: Alto volumen para captación de usuarios.

- Tier Medio ($3 – $6 por millón de tokens): Optimizado para tareas estándar de productividad.

- Tier Profesional ($45 por millón de tokens): Modelos de razonamiento avanzado con mayor contexto.

- Tier Premium ($150 por millón de tokens): Diseñado para investigación crítica y flujos de ingeniería de alto valor.

Open Claw y la transición al modelo Agentic-as-a-Service

El anuncio de Open Claw establece lo que Huang denomina el “sistema operativo de los agentes”. No se trata solo de un marco de trabajo, sino de una estructura que gestiona archivos, APIs y flujos de trabajo de manera autónoma. Para el entorno corporativo, esta evolución implica que cada empresa de Software-as-a-Service (SAS) debe transformarse en una empresa de Agentic-as-a-Service (AaaS).

Para mitigar los riesgos de seguridad derivados de agentes con capacidad de ejecutar código y acceder a datos sensibles, NVIDIA presentó Nemo Claw (basado en Open Shell). Esta solución actúa como una capa de gobernanza y seguridad empresarial, garantizando que los agentes operen bajo políticas de privacidad estrictas, evitando fugas de datos hacia el exterior.

IA Física: El momento “ChatGPT” de la robótica

La inteligencia artificial ha trascendido lo digital para entrar en el dominio de lo físico. La plataforma Alpamo para vehículos autónomos, adoptada por BYD, Hyundai y Nissan, introduce capacidades de razonamiento: el vehículo ahora puede explicar verbalmente sus decisiones (ej. “cambio de carril porque hay un vehículo estacionado en doble fila”).

Este avance se sustenta en el ecosistema Omniverse (Isaac Lab, Cosmos y el solver Newton), donde los robots —incluyendo los humanoides de Disney— se entrenan en simulaciones que respetan las leyes de la física. Para la industria, esto significa que el cómputo es ahora el generador de los datos necesarios para cerrar la brecha entre el entrenamiento virtual y el despliegue en el mundo real.

Coalición Neotron: Soberanía tecnológica y modelos abiertos

Frente a los ecosistemas cerrados, NVIDIA lidera la Coalición Neotron junto a socios como Mistral, Perplexity y Black Forest Labs. Los modelos Neotron 3 y 4 se posicionan como la base para la “IA Soberana”, permitiendo que naciones y corporaciones desarrollen inteligencia propietaria en dominios específicos como biología (Bioneo), física y clima (Earth 2). Al ofrecer modelos de frontera en formato abierto, NVIDIA asegura que las organizaciones mantengan el control sobre su propiedad intelectual y sus recetas de entrenamiento, evitando la dependencia absoluta de proveedores de nubes específicas.

El ROI en la era de la inferencia

Los anuncios del GTC 2026 transforman el CAPEX en infraestructura en una vía directa hacia la generación de ingresos. La capacidad de producir inteligencia a una escala de 700 millones de tokens por segundo redefine las reglas financieras del sector.

Para el CIO, el desafío ya no es solo la adquisición de potencia de cómputo, sino la orquestación de una fábrica que entregue valor operativo a través de agentes seguros y robots capaces de razonar. La computación acelerada no es una opción técnica; es el único camino para sostener la productividad en una economía que se mide por la velocidad y calidad de sus tokens.