AWS cierra la brecha tecnológica y podría cambiar las reglas del juego para las empresas de Latinoamérica tras sus más recientes anuncios.

Amazon presenta su CPU más potente, agentes de IA que trabajan días sin intervención y chips Trainium3 que reducen costos de entrenamiento hasta 50%.

Foto de Amazon News.

AWS presentó en re:Invent 2025 una serie de innovaciones que redefinen el panorama de la computación en la nube y la inteligencia artificial empresarial. El evento mostró desde procesadores de nueva generación hasta agentes de IA capaces de operar sin supervisión durante días enteros.

Los CIOs latinoamericanos enfrentan una paradoja: deben competir globalmente con presupuestos regionales. Mientras las corporaciones en mercados desarrollados invierten millones en infraestructura de IA, América Latina opera con restricciones de capital que históricamente han limitado el acceso a tecnología de punta.

Los anuncios de AWS en re:Invent 2025 alteran esta ecuación radicalmente. No se trata solo de hardware más potente o servicios más sofisticados. El verdadero cambio está en la democratización del acceso: agentes autónomos que eliminan la necesidad de equipos masivos de desarrollo, chips que reducen costos de entrenamiento a la mitad, y modelos que permiten a empresas medianas competir con capacidades que antes eran exclusivas de gigantes tecnológicos.

Para un CIO en São Paulo, Buenos Aires o Ciudad de México, esto significa que la brecha tecnológica con Silicon Valley se estrecha no por alcanzarlos en inversión, sino porque AWS está bajando el costo de entrada a la innovación. Un banco regional puede ahora implementar agentes de IA que trabajan como un equipo de 20 desarrolladores. Una retailer puede entrenar modelos personalizados sin construir infraestructura propia. Una fintech puede competir con bancos establecidos usando la misma potencia computacional, pagando solo por uso.

La pregunta para los líderes tecnológicos de la región ya no es “¿cuándo podremos costear IA avanzada?” sino “¿qué haremos con ella ahora que está al alcance?”. Esta es la ventana de oportunidad donde la agilidad latinoamericana puede convertirse en ventaja competitiva.

El Graviton5 lidera esta ola de innovación como el procesador más potente desarrollado por AWS hasta la fecha. Las nuevas instancias EC2 M9g ofrecen un incremento del 25% en rendimiento respecto a la generación anterior, con 192 núcleos por chip y una caché cinco veces mayor. El dato más revelador: durante tres años consecutivos, más de la mitad de la capacidad de CPU agregada a AWS utiliza Graviton, con el 98% de los 1,000 principales clientes de EC2 —incluidos Adobe, Airbnb, Epic Games y SAP— beneficiándose de sus ventajas en precio-rendimiento.

Agentes frontera: cuando la IA trabaja sin descanso

AWS introdujo una categoría completamente nueva: los agentes frontera. Estas herramientas representan un cambio cualitativo en capacidades de automatización. Son autónomos, escalables y pueden trabajar durante horas o días sin intervención humana.

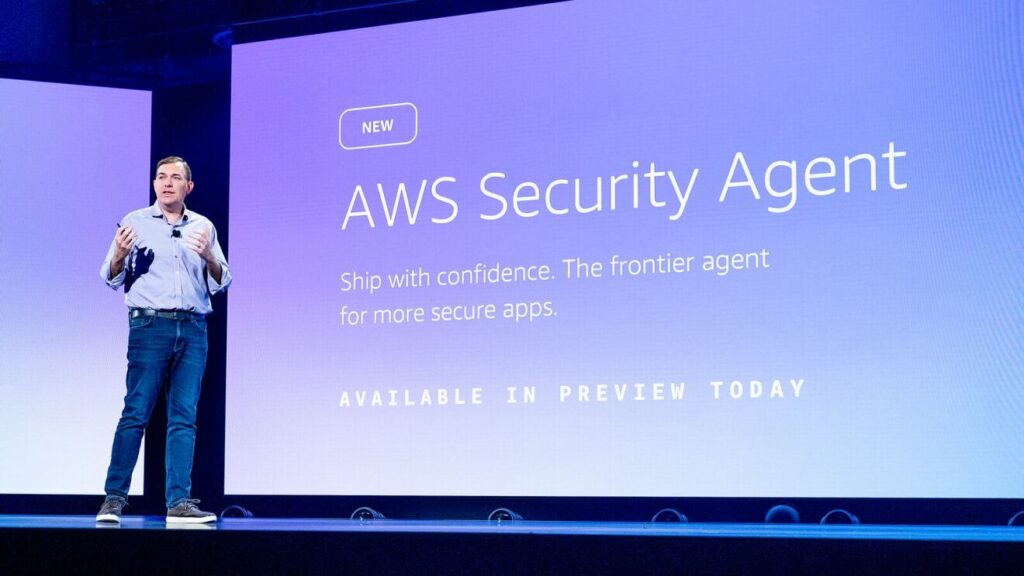

La compañía anunció tres agentes frontera específicos. Kiro actúa como desarrollador virtual para equipos de software. AWS Security Agent funciona como consultor de seguridad dedicado. AWS DevOps Agent opera como equipo de guardia operacional. Empresas como Commonwealth Bank of Australia, SmugMug y Western Governors University ya utilizan estos agentes para transformar su ciclo de desarrollo de software.

Trainium3: potencia de entrenamiento a menor costo

Los Trainium3 UltraServers abordan uno de los desafíos más críticos de la IA actual: el costo prohibitivo del entrenamiento de modelos avanzados. Estos servidores, equipados con el primer chip de IA de 3nm de AWS, integran hasta 144 chips Trainium3 en un solo sistema.

Los números demuestran su impacto: 4.4 veces más rendimiento computacional y cuatro veces mayor eficiencia energética que los UltraServers Trainium2. Los clientes logran un throughput tres veces superior por chip y tiempos de respuesta cuatro veces más rápidos, reduciendo entrenamientos que tomaban meses a semanas. Anthropic, Karakuri, Metagenomi y otros clientes reportan reducciones de hasta 50% en costos de entrenamiento e inferencia. Decart alcanza inferencia cuatro veces más rápida para video generativo en tiempo real, a la mitad del costo de GPUs.

Amazon Nova: expansión con “entrenamiento abierto”

Amazon expandió su portafolio Nova con cuatro modelos nuevos que ofrecen precio-rendimiento líder en razonamiento, procesamiento multimodal, IA conversacional y generación de código.

Nova Forge introduce el concepto de “entrenamiento abierto”, permitiendo a organizaciones acceder a checkpoints de modelos pre-entrenados y combinar datos propietarios con conjuntos de datos curados por Amazon Nova. Nova Act alcanza 90% de confiabilidad en flujos de automatización de interfaz de usuario basados en navegador. Reddit utiliza Nova Forge para reemplazar múltiples modelos especializados con una solución única, mientras Hertz aceleró su velocidad de desarrollo cinco veces con Nova Act.

Bedrock AgentCore: infraestructura para producción

Amazon Bedrock AgentCore introduce capacidades para llevar agentes desde prototipo hasta producción. La plataforma lanza Policy en vista previa, permitiendo establecer límites claros para acciones de agentes usando lenguaje natural. AgentCore Evaluations simplifica el monitoreo con 13 evaluadores pre-construidos para dimensiones como corrección y seguridad. La funcionalidad Memory episódica permite a los agentes aprender de experiencias pasadas.

Casos de uso reales validan la propuesta. PGA TOUR construyó un sistema de generación de contenido multi-agente que incrementó la velocidad de escritura 1,000% con reducción de costos del 95%. MongoDB eliminó semanas de ciclos de evaluación y consolidó herramientas dispares en una solución única lista para producción. Swisscom lanzó su solución de agentes business-to-consumer en cuatro semanas.

Infraestructura y servicios complementarios

AWS anunció P6e-GB300 UltraServers con arquitectura GPU NVIDIA GB300 NVL72, las más avanzadas en Amazon EC2, ideales para inferencia de IA a escala con modelos de trillones de parámetros. Lambda Managed Instances cierra la brecha entre simplicidad serverless y control de infraestructura, permitiendo ejecutar funciones Lambda en instancias EC2 elegidas.

GuardDuty Extended Threat Detection expandió cobertura a ambientes EC2 y ECS, correlacionando señales de amenazas en un solo evento crítico mediante modelos de IA y machine learning. Amazon S3 Vectors alcanza disponibilidad general escalando a dos billones de vectores por índice y reduciendo costos hasta 90% frente a alternativas.

El mensaje de re:Invent 2025 es claro: AWS no solo ofrece infraestructura, sino ecosistemas completos donde hardware personalizado, servicios gestionados y capacidades de IA convergen para resolver problemas empresariales reales a escala global.